不是机房,而是工厂?AI正在重新定义数据中心!

2026年3月的科技圈,被两个关键词霸屏。

“龙虾”——这个源于OpenClaw的开源AI智能体项目,短短几周内GitHub星标数突破18万,官网访问量达到200万人次,成为全球增长最快的开源AI项目之一。后来百度、阿里、腾讯等品牌高速推出红手指Operator、DuClaw等产品,将这只“小龙虾”送进了亿万用户的电脑和手机。

“GTC”——英伟达创始人黄仁勋在主题演讲中抛出一个重磅判断:AI已从训练时代全面进入“推理+智能体+物理AI”的工业化时代,Token正在成为新的数字商品,而数据中心将被重定义为“Token工厂”。

AI的进步,正在掀起一波又一波的科技浪潮,未来会在生产与生活中占据越发重要的位置。

而随着AI的大量使用,大量的计算使用带来巨大的负载压力,想要供给这样的AI使用需求,AI数据中心(AIDC)应运而生。

与传统的数据中心不尽相同,AI数据中心是专为大模型训练和推理设计的“超级计算机集群”,借助专门的AI基础设施,支持AI工作负载的大量计算需求。

今天,我们就一起来揭开它的神秘面纱。

01 AI数据中心是做什么的?

AIDC主要围绕AI模型的“训推用”三个环节发挥作用:

1、基础模型预训练

大型互联网企业构建万亿级Token数据的基础模型,需要十万甚至百万量级算力卡的超大规模集群。例如训练GPT-5、Grok4这类模型,背后就是AIDC在支撑。

2、行业模型二次训练

金融、医疗、制造等行业的头部企业,基于通用模型叠加行业数据二次训练,需要数百至数千张GPU/NPU算力卡。

3、模型微调与推理

绝大多数企业将AIDC作为模型微调和推理的核心平台——你每次用ChatGPT问问题,背后都有一台AIDC在毫秒级完成推理计算。ToC服务要求低延迟,ToB服务要求高并发,AIDC需针对不同场景优化。

02 AI数据中心 vs 传统数据中心:到底哪里不一样?

走进一座传统数据中心,我们会看到整齐排列的机柜,每柜功耗稳定在5-10千瓦——这是过去十几年的常态。

但如果你走进一座AI数据中心,看到的将是完全不同的景象:机柜里的服务器密密麻麻,GPU芯片紧挨着芯片。根据AFCOM发布的第十次年度数据中心状态报告,2025年数据中心平均机架密度达到27千瓦,较2024年的16千瓦增长69%,创下该报告十年历史中的最大同比增幅。

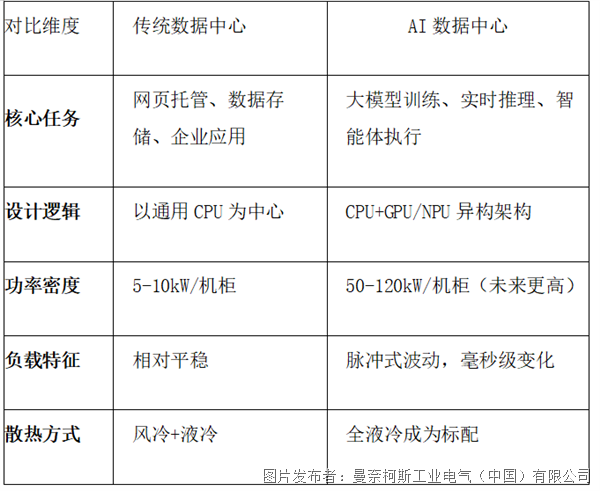

将两者的功能从多个维度进行对比,就能看出二者的本质区别:

AI数据中心引发的变革不仅是技术升级,更是整个产业链的重构。从机架结构、供配电系统到散热方案,从建设模式、投资规模到运维理念,AI的进入正在重新定义数据中心的每一个环节。

02 AI数据中心的性能优势

AI数据中心的核心性能优势,体现在三个层面:

1、算力密度跃升

AI数据中心的核心能力,便是带来算力功率密度的大幅提升。比如NVIDIA在GTC 2026上宣布,下一代Rubin Ultra系统每机架功耗将突破600千瓦,容纳576个GPU。

为什么需要这么高的密度?因为AI训练需要的是大规模并行计算,这种功率密度的跃升已远超传统数据中心基础设施的设计极限,是独属于AI数据中心的优势领域。

2、系统能效优化

NVIDIA在GTC 2026上释放了一个极具指向性的信号:数据中心的度量标准正在从传统的峰值算力,转向“每瓦Token产出效率”(Token per Watt)。

这一变化背后的逻辑是:当Token成为核心产出单位时,供电、冷却、网络、调度乃至建筑交付周期,都会被纳入同一个经济模型进行统一优化,便于统一管理优化,实现“每瓦最大Token产出”以及更快的部署速度。

3、架构创新

如果说高密度是“堆人”,那么架构创新就是“让这些人能高效协作”。

在AI数据中心,计算、网络、存储三方会深度融合,构建全互联无损网络,让算力、内存、网络资源像工厂里的流水线一样被统一管理,哪里需要就调哪里。

03 为什么要建AI数据中心?

答案很简单:传统数据中心已经不能完全满足AI时代的算力需求了。

麦肯锡估计,到2030年底,AI预计将驱动近70%的总需求。

在这个算力需求指数级爆发的时代,传统模式长周期建设模式,已无法满足算力快速迭代、应用创新加速、业务即时上线的迫切需求。

算力需求的爆炸增长,不仅来自于大模型的应用,还有芯片功耗的大幅增长。在实际的使用场景中,智能算力不仅需要高密部署,还需要满足绿色可持续需求。

这就是AI数据中心的必要性,在数据技术架构发生变化的当下,AI数据中心可以帮忙兜底。亚马逊、微软、谷歌母公司Alphabet、Meta四大科技巨头2026年资本支出合计将达6150亿美元用于AI基础设施建设,AI数据中心的重要性可见一斑。

04 AI数据中心的展望与挑战

数据中心设计将继续向更高密度、更大规模、更智能化方向演进,甚至还有希望将其推向太空:

2025年底,英伟达支持的太空计算公司Starcloud成功将一颗搭载H100 GPU的卫星送入轨道,在太空中首次完成了Nano-GPT模型的训练。GTC 2026上,英伟达进一步发布了“Space 1 Vera Rubin Module”轨道数据中心,其AI算力为H100的25倍。

不过与此同时,AI数据中心也会在未来面临两个重大挑战:

保障稳定的技术挑战

AI机柜需要配备更高功率密度的UPS系统、电池组、配电以及开关设备,以应对AI负载从10%闲置状态瞬间激增到150%过载的巨大波动,同时液冷系统需要与高密度UPS协同工作来保障系统的稳定运行。

目前大多采用的混合冷却系统形态多变,但技术要求更高,增加了新的故障点和维护复杂度,对运维团队的专业能力提出更高要求。

资源的约束

电力资源和水资源的供给,会在AI数据中心的扩张当中成为严峻的挑战之一。

全球数据中心能源需求预计在未来五年内翻倍,美国数据中心年用水量到2028年可能翻倍甚至翻四倍,给本已紧张的区域供水系统带来额外压力。因此数据中心的设计必须考虑到电力和水资源的可持续利用,投入更多节能节水技术的发展研究。

AI数据中心,正在为这个世界带来创新发展的机遇。解锁算力,就是解锁未来的生产力,在数据世界构筑起行业发展的摩天大楼!

随着AI的深入使用,曾经看似离普罗大众很遥远的前沿概念,似乎也会成为生活的一部分。未来,让我们一起拥抱变革,持续开拓创新,迎接与AI的共创时代!

#曼奈柯斯#AI#数据中心#OpenClow#曼奈柯斯#工业连接器#工业插头#工业插座#插座箱#用电安全

技术支持,产品询价

欢迎点击下方链接联系我们

https://www.wjx.top/vm/Qh7xcAW.aspx

提交

曼奈柯斯超低压产品系列,低压安全用电的“必答题”!

从餐桌到工厂:曼奈柯斯携手泰森食品打造“美味”心脏

DUOi 工业插座 | 轻松安装,省时省力

可视化通电!DUOi机械联锁工业插座震撼上新!

镀银or镀镍?金属镀层背后的安全密码

投诉建议

投诉建议